La semana pasada, OpenAI lanzó la última versión de su modelo líder de lenguaje grande (LLM): GPT-4o.

El LLM es multimodal, con la capacidad de pensar en tiempo real a través del sonido, la visión y el texto.

Durante muchos años, ha resultado difícil crear una IA que comprenda múltiples enfoques. Simplemente crear canales para tareas como la conversión de voz a texto es difícil debido a problemas como el alto tiempo de procesamiento.

Ahora, GPT-4o puede hacer esto casi al instante.

Sin embargo, hasta este momento, los proveedores de plataformas de IA han invertido mucho en este tipo de proyectos multimedia y están financiando Rowan Trollope, director ejecutivo de Redis Ahora se sugiere que está desactualizado.

En X (anteriormente Twitter), el director ejecutivo de Five9 declaró una vez:

Cientos de millones de dólares gastados en investigación y desarrollo de agentes de IA para centros de contacto se están volviendo obsoletos con los desarrollos de OpenAI GPT-4o. Se debe prestar atención a la automatización de back-end

Esta tampoco sería la primera vez que ChatGPT deja obsoleta la I+D en innovación de centros de contacto.

Basta pensar en cómo las versiones anteriores de LLM se quedaron atrás del trabajo de muchos proveedores de análisis, que dedicaron cientos de horas a diseñar modelos de procesamiento del lenguaje natural (NLP) para medir la intención, el sentimiento y más. LLM puede extraer todo esto de forma inmediata.

Otro ejemplo es la innovación asistida por agentes. Si bien las empresas han invertido importantes recursos de I+D en la creación de casos de uso, como aislar puntos de datos clave en una conversación con un cliente, ChatGPT y otros LLM pueden hacerlo al instante.

De hecho, esta es la razón por la que muchas empresas primero buscan implementar LLM en el centro de contacto. Los casos de uso ya existían, pero ahora son más accesibles.

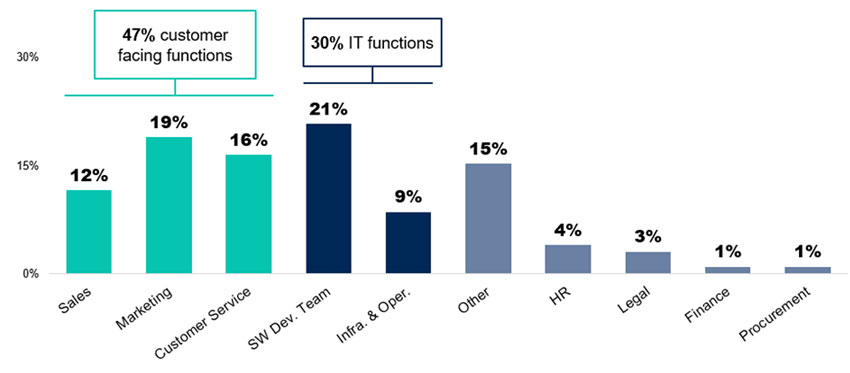

Considere el siguiente gráfico de un estudio de Gartner de octubre de 2023. Muestra cómo el servicio al cliente es un beneficiario destacado de la inversión en GenAI en una organización.

Se espera que esto continúe y, con la introducción del MBA multimedia, los casos de uso serán más innovadores. La traducción simultánea es un excelente ejemplo.

Traducción simultánea y otros casos de uso multimedia

En los últimos años, los proveedores de IA conversacional han lanzado al mercado muchos modelos de traducción en tiempo real, y marcas como Cognigy incluso los han puesto a disposición en el canal de voz.

Normalmente, estas aplicaciones utilizarán primero la conversión de voz a texto para generar texto a partir de la voz del cliente.

Luego, este texto pasa a través de un motor de traducción, como Google Translate, y el agente recibe la traducción del texto dentro de su propio espacio de trabajo.

A partir de ahí, el agente escribe su respuesta, que, a través del motor, se traduce nuevamente al idioma original y se reproduce a través de una secuencia de audio de texto a voz.

El problema fundamental de estas experiencias es el aire muerto entre el agente que habla y el agente que escribe la respuesta. Es un asesino de relaciones.

Afortunadamente, con una interpretación “estándar”, un LLM multimedia puede ser la solución.

Basta con mirar este ejemplo publicado por OpenAI para GPT-4o, que traduce una conversación en vivo entre hablantes nativos de inglés y español.

Más allá de la traducción, considere cómo la IA puede ajustar el acento del agente a uno que le resulte más familiar al cliente, garantizando una comprensión completa.

Krisp ya ofrece este caso de uso. Sin embargo, con GPT-4.0, es posible que esté mucho más disponible. Después de todo, una demostración de OpenAI mostró una voz impulsada por GPT que cambiaba patrones sobre la marcha.

Como ejemplo final, considere cómo GPT-4o transforma las conversaciones entre un cliente y un agente virtual.

Por ejemplo, considere cuántos proveedores importantes de IA conversacional han mejorado sus soluciones con reconocimiento de imágenes (IR) para reconocer entidades dentro de imágenes y brindar recomendaciones automatizadas. Multimedia LLM proporciona esta capacidad de forma inmediata.

Agregar esta capacidad a un agente virtual puede permitir muchos casos de uso de agentes virtuales en varios sectores, incluidos el comercio minorista, los servicios públicos y el sector público.

Tomemos el ayuntamiento como ejemplo de esto último. Si alguien tuitea una foto de un mueble defectuoso en la calle y comparte la ubicación, GPT-4o puede determinar si pertenece al ayuntamiento.

A través de esta verificación, LLM puede desencadenar una respuesta automatizada y personalizada y desencadenar un flujo de trabajo planificado previamente para resolver dichos problemas.

Es probable que el próximo campo de batalla sea garantizar una coordinación institucional adecuada para estos casos de uso, como sugirió Trollope, especialmente dada la complejidad de estas características innovadoras.

GPT-4o: la historia empresarial más amplia

El lanzamiento de GPT-4o proporciona más información sobre el futuro de las interacciones con los clientes.

Por ejemplo, tal vez la siguiente demostración de dos dispositivos GPT-4os interactuando y cantando arroje algo de luz sobre el futuro cuando los clientes de hardware y los servidores proxy hablen en nombre de sus homólogos humanos.

Sin embargo, también es fascinante pensar en cómo OpenAI decidió realizar todas estas demostraciones a través de un teléfono inteligente, navegando entre modalidades GPT-4o, casi convirtiéndose en una extensión de los sentidos.

Esto sugiere que se está moviendo hacia el mercado móvil para expandir el alcance de la IA generativa, lo que quizás no sea sorprendente, dados los informes recientes de que OpenAI está en conversaciones con Apple sobre una integración más profunda de su tecnología en iOS.

Además, los ejemplos de teléfonos inteligentes resaltan el impacto que un MBA multimedia puede tener en el flujo de trabajo diario de los consumidores.

Sin embargo, quizás lo más importante es que, al abrir el potencial de la multimedia a toda una audiencia de usuarios, OpenAI nos acerca a una IA más barata y en tiempo real en la empresa.

Por ejemplo, los trabajadores de finanzas pueden utilizar este formulario en su flujo de trabajo cuando comparan documentos, encuentran errores y envían correos electrónicos.

Anteriormente, tenían que documentar estos procedimientos paso a paso, programarlos y crear un flujo de proceso lento e inflexible. Ahora, la IA puede adaptar y automatizar dinámicamente estos flujos de trabajo, mejorando drásticamente la eficiencia.

En otro lugar, consideremos una gran organización de bienes de consumo envasados (CPG) que utiliza planogramas para gestionar la colocación de productos.

Tradicionalmente, revisar estas ubicaciones implicaba fotografías y análisis manual. Ahora, con GPT-4.o, la empresa puede analizar secuencias de vídeo en tiempo real, superando limitaciones anteriores como la mala iluminación o las limitaciones de espacio.

Estos son sólo dos de muchos ejemplos que destacan cómo GPT-4.o automatiza procesos de flujo de trabajo complejos y mejora las interacciones en tiempo real en toda la empresa.

Sin embargo, como concluyó Trollope, su integración exitosa depende del desarrollo de procesos de integración de back-end, además de personalizar el modelo según necesidades específicas y garantizar respuestas precisas y conscientes del contexto.

«Experto en Internet. Lector. Fanático de la televisión. Comunicador amistoso. Practicante de alcohol certificado. Aficionado al tocino. Explorador. Malvado adicto a los tweets».

More Stories

Harry Potter: Campeones de Quidditch anunciados oficialmente – Juegos de Verano 2024

Civilization 7 se filtra antes del festival de verano del juego

OPPO confirma el lanzamiento global de la serie Reno 12 y los teléfonos inteligentes insignia Find X: consulte los detalles